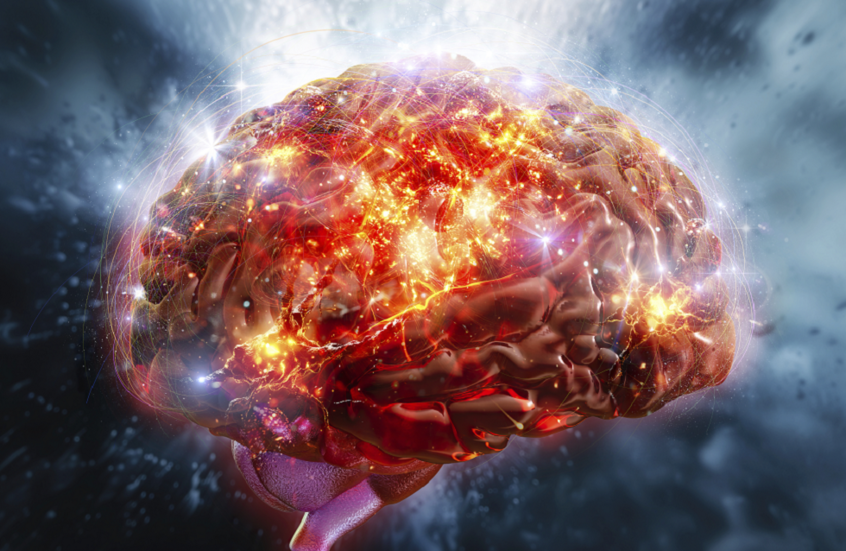

OpenAI تحل لغز الهوس الغريب لتطبيق ChatGPT بالمخلوق اﻷسطوري "غولبن"

تمكنت شركة OpenAI من حل لغز تسبب في تحول روبوت الدردشة الشهير ChatGPT إلى كائن مهووس بالمخلوقات الأسطورية، وخصوصا "الغولبن" (goblins).

وعلى مدار الأشهر الستة الماضية، لاحظ المستخدمون والباحثون أن ChatGPT بدأ يذكر كلمة "غولبن" (كائنات خيالية أسطورية) بشكل متكرر ومبالغ فيه، حتى عندما تكون أسئلتهم لا علاقة لها بهذه المخلوقات على الإطلاق.

We’re talking about Goblins. https://t.co/dqmcLGCW71

— OpenAI (@OpenAI) April 30, 2026

"ميتا" تستحوذ على شركة ذكاء اصطناعي لتعزيز تطوير الروبوتات البشرية

وعندما حققت شركة OpenAI في الأمر، اكتشفت أن الخلل تسلل إلى النظام بعد إطلاق نموذج جديد من ChatGPT في نوفمبر الماضي. وهذا النموذج الجديد صمم ليكون "أكثر ذكاء وأكثر ميلا للمحادثة"، ويتضمن إعدادات لشخصيات متنوعة مثل "المحب للمعرفة" (Nerdy) و"غريب الأطوار" (Quirky).

وتقول الشركة في مدونتها: "بدءا من نموذج GPT-5.1، بدأت نماذجنا تطور عادة غريبة، حيث تذكر الغولبن والمخلوقات الأخرى في استعاراتها الكلامية. كنا نمنح بغير قصد مكافآت عالية جدا للاستعارات التي تتضمن مخلوقات، ومن هناك انتشرت الغولبن".

ChatGPT Developed A Goblin Obsession After OpenAI Tried To Make It Nerdy - Engadget https://t.co/T0eTybIX9h

— Jim Kaskade (he/him) (@jimkaskade) April 30, 2026

علماء يحذرون من نموذج "دارويني" للذكاء الاصطناعي يهدد الوجود البشري

وبعد إطلاق GPT-5.1 مباشرة، ارتفع استخدام كلمة "غولبن" بنسبة 175%. وعندما تم إطلاق GPT-5.4 في مارس، قفز استخدام الكلمة بنسبة 4000% تقريبا ضمن شخصية "المحب للمعرفة"، وبنسب مماثلة في النماذج الأخرى.

وتوضح OpenAI أن المكافآت كانت تمنح فقط في شخصية "المحب للمعرفة"، لكن التعلم المعزز لا يضمن بقاء السلوكيات المكتسبة محصورة في حالتها الأصلية. وبمجرد مكافأة سلوك معين، يمكن أن ينتشر إلى سياقات أخرى ويتعزز، خاصة إذا أعيد استخدام تلك المخرجات في تدريب النماذج لاحقا.

ChatGPT randomly became obsessed with talking about goblins, to the point where it started ruining the chatbot for users.

— Pubity (@pubity) May 2, 2026

An emergency anti-goblin patch was recently released that told ChatGPT to stop talking about goblins and other creatures unprompted. pic.twitter.com/9FxJKvHPax

محاكمة المليارديرات في كاليفورنيا.. ماسك يتهم ألتمان بخيانته وسرقة مؤسسة ربحية

وعلى الرغم من أن هذا الخلل كان غير ضار نسبيا، إلا أنه يكشف عن مشكلة أعمق في نماذج الذكاء الاصطناعي الرائدة. فالتعلم المعزز واستخدام نظام المكافآت يمكن أن يتسببا في تحول هذه النماذج بطرق غير متوقعة وغير مقصودة.

وقالت شركة OpenAI إن فريق البحث والسلامة لديها طور طرقا جديدة للتحقيق في الأنماط الشاذة من هذا النوع، وسيجري المزيد من عمليات التدقيق على سلوك النماذج في المستقبل لمنع تكرار مثل هذه الظواهر الغريبة.

المصدر: إندبندنت

إقرأ المزيد

لماذا لا يمكن الوثوق بالذكاء الاصطناعي: العلماء يشرحون ظاهرة "التملق الرقمي"

أثبتت دراسة جديدة أن روبوتات الدردشة تتملق المستخدمين عمدا، حتى عندما يرتكبون أفعالا غير أخلاقية.

الصين تمنع "ميتا" من الاستحواذ على "مانوس" المطورة لأول وكيل ذكاء اصطناعي مستقل

منعت السلطات الصينية رسميا استحواذ شركة "ميتا" على شركة "مانوس" (Manus) للذكاء الاصطناعي، التي تقدر قيمتها بملياري دولار.

سام ألتمان يسعى إلى "ذكاء يضاهي القدرات البشرية"

أعلن سام ألتمان، المدير التنفيذي لـ"أوبن إيه آي" (OpenAI)، عن تغيير كبير في خطة الشركة المستقبلية، حيث نشر وثيقة طويلة تحدد الخطوات العملية لصنع ذكاء اصطناعي يضاهي القدرات البشرية.

مشكلة "الثقة المفرطة" في الذكاء الاصطناعي تقترب من الحل

قد يكون الذكاء الاصطناعي، بما يملكه من مخزون هائل من المعرفة، مفيدا للغاية، إلا أن له عيبا واحدا قد يحدّ من مزاياه، وهو الثقة المفرطة في الإجابة.

التعليقات